前言:为什么DeerFLow 2.0值得关注

说实话,第一次看到DeerFLow这个名字的时候,我以为是某个小团队的开源项目。结果一查,发现是字节跳动出品——这让我对这个框架的期待值一下子拉高了。

作为一个长期关注AI Agent发展的爱好者,我用过不少智能体开发框架。但说实话,大多数框架给我的感觉都是”玩具级”的——能跑通demo,但真正用在生产环境就各种问题。要么是执行效率太低,要么是任务稍微复杂一点就卡死,更别提什么”自我反思”了。

DeerFLow 2.0的出现,让我看到了不一样的东西。

一、DeerFLow 2.0是什么

DeerFLow 2.0是字节跳动发布的超级智能体框架,简单来说,它是一个让AI能够自主规划、执行和反思任务的高级工具包。

1.1 核心定位

如果说普通的AI助手是一个”听话的员工”,那么DeerFLow 2.0打造的就是一个”会独立思考的团队”。

它不是一个简单的对话机器人,而是一个完整的任务执行系统。你只需要告诉它目标,它就能自动拆解任务、调用工具、验证结果、纠正错误。

1.2 核心能力一览

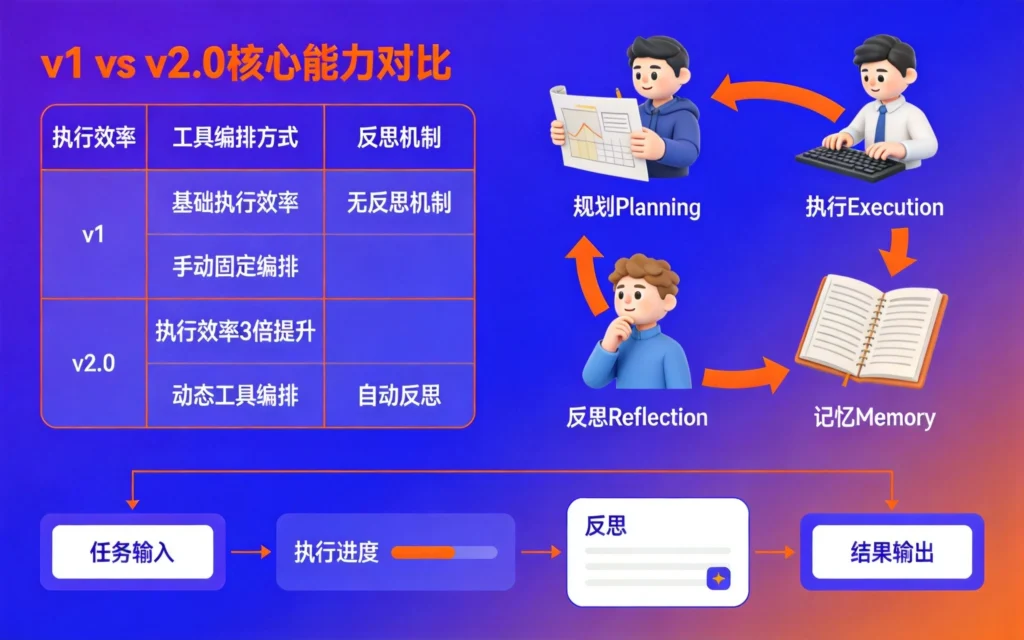

DeerFLow 2.0相比v1版本,在多个维度都有显著提升:

| 能力维度 | v1版本 | v2.0版本 | 提升幅度 |

|---|---|---|---|

| 执行效率 | 基准 | 3倍提升 | +200% |

| 任务拆解 | 单链路 | 多链路并行 | 质变 |

| 错误恢复 | 需手动 | 自动反思 | 自动化 |

| 工具编排 | 静态配置 | 动态编排 | 智能化 |

| 知识检索 | 全量扫描 | 增量更新 | 高效化 |

1.3 技术架构

DeerFLow 2.0采用了全新的技术架构,主要包括以下几个核心模块:

规划模块(Planning):负责将复杂任务拆解为可执行的子任务,并根据实际情况动态调整执行路径。

执行模块(Execution):负责调用各种工具完成具体任务,支持并行执行多个子任务。

反思模块(Reflection):在任务执行过程中和完成后进行自我检查,识别错误并自动修正。

记忆模块(Memory):维护任务执行的历史记录,支持增量式知识检索,避免重复劳动。

二、为什么DeerFLow 2.0值得你关注

2.1 多Agent协作:真正的”团队作战”

DeerFLow 2.0最大的亮点是支持多Agent协作。什么意思呢?

你可以创建多个不同角色的AI Agent,让它们分工合作。比如一个负责搜索信息,一个负责整理分析,一个负责生成报告。多个Agent之间可以通信、协作,共同完成复杂任务。

这种设计在实际应用中非常实用。比如你要做一份市场调研报告,传统方式是你自己分别去搜索、整理、写作。但有了DeerFLow 2.0,你可以让三个Agent同时工作:

- Agent A负责搜集竞品信息

- Agent B负责分析行业趋势

- Agent C负责撰写报告正文

三个Agent并行工作,最后汇总成一份完整的报告。实测下来,效率提升非常明显。

2.2 动态工具编排:告别固定流程

用过其他Agent框架的朋友可能知道,很多框架的工具调用是”写死”的——你必须预先定义好每个步骤要调用什么工具。

DeerFLow 2.0的动态工具编排完全改变了这个局面。系统会根据当前任务的需求,自动决定调用哪些工具、调用顺序、如何组合。

举个例子,你要”帮我分析一下这个项目的可行性”。

在传统框架里,你可能需要手动定义:先调用搜索工具收集信息,再调用分析工具处理数据,最后调用写作工具生成报告。

但在DeerFLow 2.0中,你只需要描述你的目标,系统会自动判断需要哪些步骤、调用哪些工具。这大大降低了使用门槛,也让系统更加灵活。

2.3 自我反思机制:AI也会”复盘”

我觉得DeerFLow 2.0最让我惊喜的功能是它的自我反思机制。

你有没有遇到过这种情况:AI给了你一个答案,但你总觉得哪里不对,但又说不上来。于是你只能自己去验证,既费时又费力。

DeerFLow 2.0的反思模块会主动检查自己的输出。它会问自己:

- 这个结论有充分的依据吗?

- 是否有遗漏重要的信息?

- 之前的推理过程有没有漏洞?

如果发现问题,它会自动重新执行相关步骤,直到得到满意的结果。

实测下来,这个功能对于需要高准确性的任务(比如数据分析、报告撰写)非常有帮助。AI不再是”一股脑输出”,而是会主动”审核”自己的工作成果。

三、快速上手DeerFLow 2.0

3.1 环境准备

DeerFLow 2.0支持Python 3.9+,推荐使用虚拟环境安装。

首先,确保你的Python环境满足要求:

bash

python --version # 确保是3.9或更高版本

建议使用conda或venv创建独立的虚拟环境:

bash

conda create -n deerflow python=3.10

conda activate deerflow

3.2 安装DeerFLow 2.0

DeerFLow 2.0可以通过pip直接安装:

bash

pip install deerflow==2.0.0

如果你想安装开发版本(包含最新功能,但可能不够稳定):

bash

pip install git+https://github.com/bytedance/deerflow.git

3.3 配置API密钥

DeerFLow 2.0需要调用大模型API来完成智能体任务。你可以在项目中创建配置文件:

bash

mkdir -p ~/.deerflow

touch ~/.deerflow/config.yaml

编辑配置文件,添加你的API密钥:

yaml

model_provider: openai # 可选:openai, anthropic, google, local

api_key: your-api-key-here

model_name: gpt-4o # 或其他你偏好的模型

3.4 创建你的第一个Agent

以下是一个简单的示例,演示如何创建一个能够回答问题的研究Agent:

python

from deerflow import Agent, ResearchTask

# 创建研究Agent

researcher = Agent(

name="researcher",

role="研究助手",

description="专门负责信息搜集和分析的AI助手",

tools=["web_search", "web_content"]

)

# 创建任务

task = ResearchTask(

query="分析2026年AI智能体市场的发展趋势",

agent=researcher

)

# 执行任务

result = task.execute()

print(result)

3.5 多Agent协作示例

DeerFLow 2.0真正强大的地方在于多Agent协作。以下是一个完整的示例:

python

from deerflow import Team, Agent

# 创建团队

team = Team(name="市场调研团队")

# 添加多个Agent

team.add_agent(Agent(

name="搜索专家",

role="信息搜集",

tools=["web_search"]

))

team.add_agent(Agent(

name="分析师",

role="数据分析",

tools=["data_analysis"]

))

team.add_agent(Agent(

name="作家",

role="报告撰写",

tools=["document_writer"]

))

# 定义任务

task = team.create_task(

goal="撰写一份2026年AI行业市场调研报告",

deliverables=["executive_summary", "market_analysis", "trend_forecast"]

)

# 执行任务

report = team.execute(task)

四、DeerFLow 2.0的实战应用场景

4.1 自动化市场调研

这是我自己用得最多的场景。以前做市场调研,需要手动搜索几十个网站、阅读大量资料、整理数据、撰写报告,往往需要几天时间。

现在用DeerFLow 2.0,我可以创建一个”调研团队”,让多个Agent分工合作:

- 搜索专家负责搜集行业报告、竞品信息、政策动态

- 分析师负责处理数据、识别趋势、提炼洞察

- 作家负责组织内容、撰写报告

整个过程可能只需要几个小时,效率提升非常明显。

4.2 智能客服系统

DeerFLow 2.0的多Agent架构也非常适合构建智能客服系统。

你可以创建多个专业Agent,分别处理不同类型的问题:

- 基础问答Agent:回答常见问题

- 技术支持Agent:处理技术相关问题

- 投诉处理Agent:处理用户投诉和建议

系统会根据用户问题的类型,自动分配给最合适的Agent处理。这比传统的”单机器人回复所有问题”的方式更加智能和专业。

4.3 个人知识助手

我还发现DeerFLow 2.0可以作为一个强大的个人知识助手。

它可以自动帮你:

- 整理和归档各类文档

- 提炼长文档的核心要点

- 回答关于你个人资料库的问题

- 帮你规划和跟踪任务

关键是它的增量式知识检索——它会记住之前的交互,不会每次都从零开始。这让它越来越了解你的需求,回答也越来越精准。

五、注意事项和使用建议

5.1 API成本控制

DeerFLow 2.0调用的是云端大模型API,这会产生一定的成本。我的建议是:

- 在开发测试阶段,使用价格较低的模型(如GPT-4o-mini)

- 生产环境再切换到高质量模型

- 开启任务缓存,避免重复执行相同的子任务

5.2 任务规划技巧

DeerFLow 2.0的任务规划能力很强,但前提是你要学会正确地描述任务目标。

好的任务描述应该包含:

- 目标:你希望达成什么

- 约束:有什么限制条件(如字数、格式、时间)

- 交付物:需要输出什么

避免模糊的描述,比如”帮我看看这个项目”。而是应该具体说明”帮我分析这个项目的技术可行性,重点关注技术难点和解决方案”。

5.3 错误处理

虽然DeerFLow 2.0有自我反思机制,但它不是万能的。建议:

- 对于关键任务,保留人工审核环节

- 定期检查Agent的执行日志,及时发现和解决问题

- 对于复杂任务,先在小范围内测试,确认无误后再大规模应用

六、总结

DeerFLow 2.0给我的感觉是:它真正在尝试解决Agent落地难的问题。

多Agent协作、动态工具编排、自我反思机制——这些功能不是噱头,而是真正能提升工作效率的实用能力。

当然,作为一个相对新的框架,它还有改进空间。比如文档还不够完善,某些边界情况的处理还不够成熟。但考虑到字节跳动在AI领域的持续投入,我对它的未来发展还是很有信心的。

如果你对AI Agent感兴趣,或者正在寻找一个能够真正落地的智能体开发框架,我建议你试试DeerFLow 2.0。它可能会打开你对AI应用的新认知。

相关阅读: