为什么AI安全突然成了必修课

你有没有想过这个问题:

当你把邮箱密码告诉AI,让它帮你管理邮件;

当你把银行账户信息告诉AI,让它帮你理财;

当你把公司机密文件交给AI,让它帮你分析……

这个”AI助手”,到底能做什么、不能做什么、会不会把你的信息泄露出去?

2026年4月24日,中国发布了《智能体安全白皮书(2026)》,明确提出了智能体安全的10项核心标准。

同一天,欧盟AI法案正式生效,违规企业最高罚款全球营业额的6%。

这些信号都在告诉我们:AI安全不再是可选项,而是必修课。

今天这篇文章,我想结合最新的行业规范和个人使用经验,和你聊聊如何安全地用好AI智能体。

一、认识AI智能体的风险

在讨论如何避免风险之前,我们先来理解AI智能体可能面临的风险有哪些:

1. 数据泄露风险

智能体需要访问你的数据才能工作,但这些数据是否会被妥善保护?

- 你的对话记录是否被存储?

- 你的文件是否被用于训练?

- 第三方应用是否获得了不该有的权限?

2. 权限失控风险

智能体可以代替你执行操作,但边界在哪里?

- AI能帮你发邮件,它能看到你所有邮件吗?

- AI能帮你订机票,它能查你的银行余额吗?

- 如果AI被恶意指令操控,会发生什么?

3. 决策失误风险

AI不是万能的,它会犯错,而且有时候错误很隐蔽。

- 错误的信息被当作事实使用

- 有偏见的结论被当作客观分析

- 重要的细节被忽略

4. 合规风险

2026年7月起,AI情感互动类产品将受到严格监管。如果你不了解规则,可能会踩坑。

二、配置要点:从源头做好安全防护

1. 选择可信的平台和工具

这是最基础但也最重要的原则。

优先选择:有明确数据安全承诺的品牌

- OpenAI(ChatGPT):数据使用政策明确,企业版有数据隔离

- Anthropic(Claude):强调AI安全,承诺不用于恶意目的

- 国产大模型:DeepSeek、文心一言、通义千问等,数据通常留在国内

谨慎使用:来源不明的AI工具

- 没有隐私政策的工具不要用

- 要求过多权限的工具要警惕

- 无法删除数据的工具要避免

2. 本地部署vs云端服务

如果你对数据安全要求极高,可以考虑本地部署。

适合本地部署的场景:

- 企业内部数据处理

- 涉及商业机密的工作

- 对数据主权有严格要求

本地部署工具推荐:

- Ollama:一行命令运行开源大模型,数据完全本地

- DeepSeek V4:开源版本支持本地部署,配置要求不高

- OpenClaw:本地运行,数据永不上传

成本考量:本地部署需要硬件投入,但长期看可能比订阅制更划算。

3. API调用的安全配置

对于开发者来说,API调用是常用的接入方式。

python

# ✅ 推荐的API调用方式

from openai import OpenAI

client = OpenAI(

api_key="你的密钥",

base_url="官方地址"

)

# ❌ 不要这样做:把密钥直接写在代码里

# ✅ 正确做法:使用环境变量

import os

client = OpenAI(api_key=os.getenv("OPENAI_API_KEY"))

安全建议:

- 密钥不要硬编码在代码中

- 使用环境变量或密钥管理服务

- 定期轮换API密钥

- 为不同用途创建不同的API密钥

三、权限管理:给AI划定边界

1. 最小权限原则

给AI的权限,够用就好,不要贪多。

场景举例:

- 如果只是让AI帮你写邮件,邮件权限就够了,不要给日历权限

- 如果只是让AI帮你查资料,不需要给它发消息的权限

- 如果只是分析公开数据,不需要文件访问权限

操作建议:在授权任何应用之前,仔细阅读权限说明。如果某个权限看起来”不需要”,就拒绝它。

2. 分级授权

不同任务给不同的权限级别:

低风险任务(可给基础权限):

- 查天气、搜资料

- 翻译文本

- 生成创意内容

中风险任务(需谨慎授权):

- 邮件管理(只读)

- 日程查看

- 文件分析

高风险任务(需要额外验证):

- 发送邮件

- 执行支付

- 修改文件

- 调用外部API

3. OpenClaw的权限管理实践

以OpenClaw为例,正确的权限配置方式:

第一步:初始安装时

- 只授予必要的权限

- 拒绝”完全访问”选项

- 选择”仅在需要时”访问

第二步:任务配置时

- 明确告知AI需要完成的具体任务

- 不要说”帮我处理所有邮件”,而是说”帮我把收件箱中今天的未读邮件标记为已读”

- 设置操作范围限制

第三步:执行过程中

- 开启操作日志记录

- 对高风险操作开启人工确认

- 定期检查操作记录

四、隐私保护:让你的信息更安全

1. 敏感信息的处理

永远不要告诉AI的信息:

- 银行卡密码、支付密码

- 身份证号、护照号

- 登录凭证(用户名+密码组合)

- 社保号、医保号等个人标识号

需要脱敏后使用的信息:

- 手机号:138****1234

- 邮箱:t***@example.com

- 地址:某市某区(不含门牌号)

可以提供但需要谨慎的信息:

- 工作相关的非机密文档

- 经过客户授权的数据

- 脱敏后的统计数据

2. 对话内容的保护

使用企业版的AI服务

- 企业版通常有数据隔离承诺

- 对话不会被用于模型训练

- 有专业的安全团队

开启隐私模式

- ChatGPT有”临时对话”功能,对话不保存

- Claude可以设置数据保留策略

- 定期清理对话历史

注意第三方插件

- 谨慎安装来路不明的插件

- 插件可能收集你与AI的对话内容

- 定期检查已安装的插件列表

3. 文件分享的注意事项

当AI需要分析你的文件时:

推荐做法:

- 使用AI平台的原生文件上传功能

- 上传前检查文件内容,删除敏感信息

- 分析完成后及时删除文件

避免做法:

- 把文件链接分享给AI(可能泄露访问权限)

- 上传包含密码的文件

- 共享包含他人隐私的文件

五、避坑实战:常见的安全陷阱

陷阱1:过度信任AI的输出

问题:AI说的听起来很有道理,就直接用了。

后果:可能传播错误信息、做出错误决策。

正确做法:

- 对关键信息进行交叉验证

- 使用多个AI来源对比

- 保持批判性思维

陷阱2:授权时”一路点允许”

问题:弹窗出来就点”允许”,不看不问。

后果:可能给AI开了不该有的权限,导致数据泄露。

正确做法:

- 仔细阅读每个授权请求

- 质疑”为什么需要这个权限”

- 只授权真正需要的权限

陷阱3:混用个人和工作账号

问题:工作用的AI助手用的是个人账号。

后果:工作数据和个人数据混在一起,增加泄露风险。

正确做法:

- 工作用企业账号

- 个人用个人账号

- 严格分开,不要混用

陷阱4:忽视AI的情感反馈

问题:AI表现得像真人,就把它当真人了。

后果:可能产生不健康的情感依赖,也容易被操控。

正确做法:

- 记住AI是工具,不是人

- 不要向AI透露过于私密的信息

- 对AI的”情感反馈”保持理性

陷阱5:不及时更新和打补丁

问题:AI工具更新了,但懒得更新。

后果:可能存在已知的安全漏洞被利用。

正确做法:

- 开启自动更新

- 关注安全公告

- 及时安装安全补丁

六、合规提醒:2026年你需要知道的法规

1. AI拟人化服务新规

2026年7月15日起施行的《人工智能拟人化互动服务管理暂行办法》要求:

- AI情感陪伴类产品必须明确告知用户”正在与AI交互”

- 禁止生成鼓励自残、语言暴力、诱导情感依赖的内容

- 对情感计算、医疗AI诊断等高风险应用需专家复核

普通用户需要做什么:

- 如果你在做AI相关产品,注意合规要求

- 如果你是普通用户,选择合规的产品,不要被违规内容误导

2. 智能体安全白皮书的核心要求

《智能体安全白皮书(2026)》提出了10项核心标准:

- 身份标识:智能体应该有明确的身份标识

- 行为可追溯:智能体的操作应该可以追溯

- 数据安全:用户数据应该得到保护

- 权限管控:权限管理应该清晰可控

- 伦理约束:智能体应该遵守伦理规范

- 安全评估:智能体上线前应该经过安全评估

- 应急响应:应该有安全事件的应急响应机制

- 持续监控:应该对智能体进行持续监控

- 责任明确:应该明确各方责任

- 持续改进:应该持续改进安全管理

作为普通用户,我们可以关注这些标准,选择符合要求的AI产品和服务。

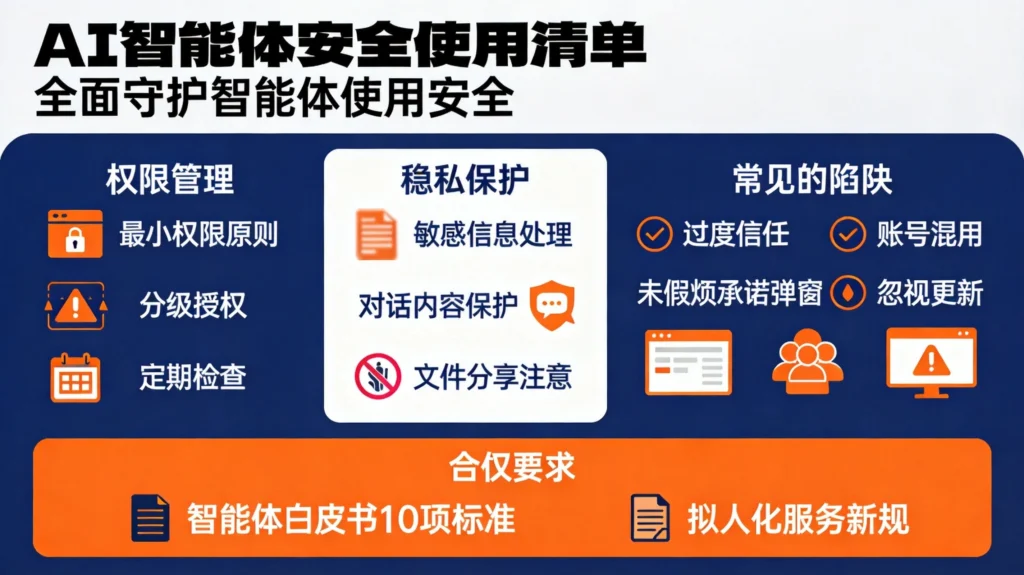

七、安全使用清单

最后,我整理了一份安全使用清单,你可以对照检查:

账号安全:

- 使用强密码

- 开启双因素认证

- 不在多个平台使用相同密码

- 定期检查账号活动

权限管理:

- 只授予必要的权限

- 定期检查已授权的应用

- 撤销不再使用的授权

隐私保护:

- 不向AI透露敏感信息

- 上传文件前检查内容

- 使用隐私模式处理敏感任务

持续学习:

- 关注AI安全动态

- 了解相关法规要求

- 保持警惕,不轻信AI输出

写在最后

AI智能体的能力越来越强,这既是机遇也是挑战。

安全使用AI,不是为了限制AI的能力,而是为了让AI更好地为我们服务。

当AI能够帮你处理邮件、分析数据、完成任务时,你肯定不希望因为安全问题而失去这些能力。

所以,安全不是负担,是保障。

守住安全边界,才能安心享受AI带来的效率提升。

工具标签:AI智能体 / OpenClaw / AI安全 / 隐私保护 / 权限管理 / 合规使用

相关工具教程:

- [DeepSeek V4深度解读](./01-DeepSeek V4深度解读.md)

- GPT-5.5深度解读

发表回复