前言:被”突然袭击”的凌晨

说实话,当我看到ChatGPT Images 2.0发布的推送时,第一反应是”又来?”。

毕竟最近几个月,AI图像生成领域真的太卷了。Midjourney V8、DALL-E 4、Google Imagen 3……每隔几周就有大厂放出新模型,一波又一波的”炸裂发布”已经让我有点审美疲劳了。

但当我真正上手体验了Images 2.0之后,我的看法改变了。

这次真的不太一样。

不是因为它生成了多么”逼真”的图片,而是因为它学会了”先思考再动手”。这个看似简单的改变,可能预示着AI图像生成的一个新方向。

下面,让我来好好聊聊这个新版本。

一、Images 2.0到底升级了什么

1.1 基础能力提升:更快、更高、更精准

先说常规升级部分,这些是官方公布的参数变化:

分辨率支持:

- 最大输出宽度提升至2000像素

- 支持更多宽高比选项,包括之前不支持的一些比例

- 对于不同的使用场景(社交媒体配图、海报、长图等)都能很好地适配

多语言支持:

- 中文支持大幅改善,不仅能正确渲染中文字符,还能理解中文的表达习惯

- 不仅是中文,日语、韩语、印地语等亚洲语言的支持也更加完善

- 以前用中文描述需求,生成结果经常”跑偏”;现在这个问题基本解决了

生成速度:

- Instant Model(快速模型)的生成时间明显缩短

- 日常任务(Logo、海报、配图等)基本在30秒内完成

- 思考模式会慢一些,但也在可接受范围内

1.2 思考模式:这次的重头戏

如果说基础升级是”常规操作”,那思考模式(Thinking Model)就是这次更新的核心亮点。

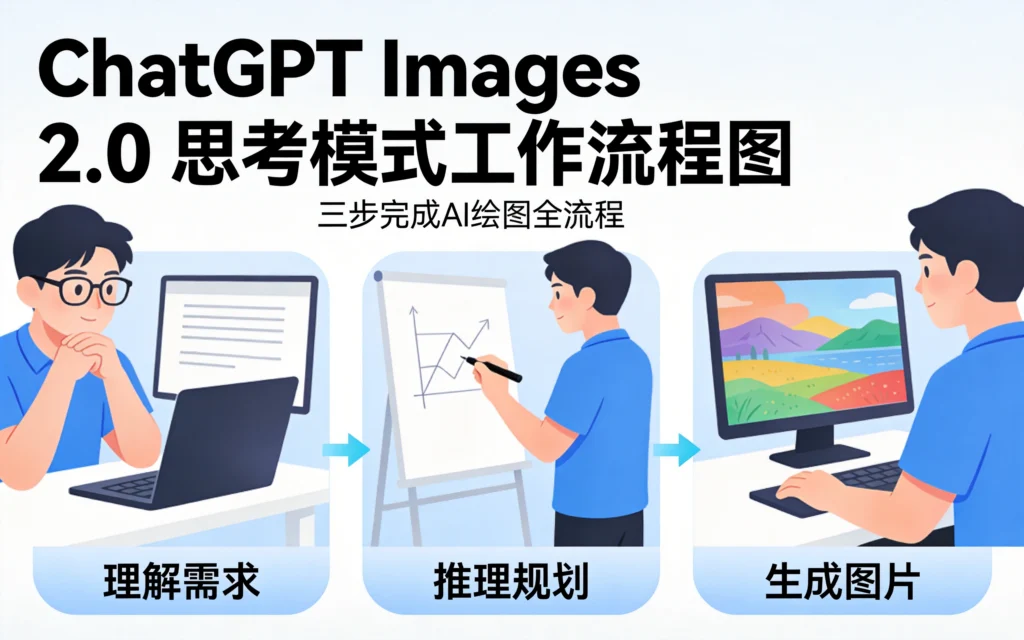

什么是思考模式?

简单来说,启用思考模式后,ChatGPT在生成图片之前会经历一个”推理”阶段。它会:

- 分析你的描述,理解你想要表达的核心内容

- 搜索相关的参考资料和信息

- 规划画面的构图、色彩、风格

- 确保多张图片之间的内容连贯性

用更直白的话说:以前的AI是”看到需求就动手”,现在的AI是”想清楚再动手”。

这个区别看起来简单,但实际效果差别很大。

实测体验

我测试了一个复杂的场景:生成一组8页的摩托车主题漫画。

按照以前的体验,让AI连续生成多张有关联的图片,最常见的问题是”画风突变”——第一张和第八张的角色可能长得完全不一样,或者背景风格完全不搭。

但用思考模式,ChatGPT先展示了一个”推理过程”:它分析了故事梗概,列出了每页的内容要点,甚至生成了简单的分镜草图。然后才开始逐页生成图片。

最终结果让我有点惊讶:8张图片的画风高度统一,连角色的头盔细节都能保持一致。这在以前的AI绘图中是很难做到的。

1.3 局部重绘:更精准的编辑能力

Images 2.0还新增了一个很实用的功能:局部重绘。

在图片查看界面,你可以直接用画笔圈出想要修改的区域,然后输入修改指令。比如:

- “把这件衣服改成蓝色”

- “背景加一个月亮”

- “把这个人的表情改成微笑”

ChatGPT只会修改你圈出的部分,其他内容保持不变。这个功能对于需要微调细节的创作者来说非常实用。

二、思考模式能解决什么问题

2.1 文字崩坏问题

用过AI绘图的朋友,可能都遇到过”文字崩坏”的问题:想要在图片中加入文字,但AI生成的结果往往是一些看不懂的”火星文”。

思考模式在一定程度上缓解了这个问题。因为AI会先把文字内容”理解”一遍,确保它知道这段文字应该出现在什么位置、以什么形式呈现,然后再生成图片。

我测试了几组包含中文的文字图片:

- 生日祝福海报:文字清晰可读,位置合理

- 书籍封面:书名、作者名、出版社都能正确显示

- 电影海报:标题文字没有出现乱码

虽然偶尔还是会有一些小问题(比如某些字体看起来还是有点”印刷感”),但相比之前已经有质的飞跃。

2.2 画风不统一问题

这是连续生成多张图片时最头疼的问题。

以前让AI生成一组漫画,经常出现:

- 主角第一张是黑发,第五张变成棕发了

- 第一张是写实风格,第四张变成卡通风格了

- 背景色调忽明忽暗,完全不连贯

思考模式通过”先规划再执行”的策略,很好地解决了这个问题。AI在开始生成之前就已经确定了整体风格和关键元素,确保每张图片都”对齐”同一个标准。

2.3 逻辑不一致问题

对于复杂场景,AI经常出现”违反物理规律”的问题:

- 影子方向和光源不一致

- 镜子里反射的内容和实际场景不匹配

- 物体的大小比例失调

思考模式让AI有机会”推理”整个场景的逻辑,在生成之前检查各个元素之间的关系。虽然不能完全杜绝这些问题,但出错概率明显降低了。

三、如何使用思考模式

3.1 开启方式

在ChatGPT中生成图片时,默认使用的是Instant Model(快速模型)。如果你想使用思考模式,需要手动切换:

- 输入图片生成指令后,等待输出

- 在生成结果的右下角,找到模型切换选项

- 选择”Thinking”模式

需要注意的是,思考模式生成速度会比快速模式慢一些,因为它需要额外的推理时间。

3.2 什么样的场景适合用思考模式

适合使用思考模式的场景:

- 连续生成多张有关联的图片(漫画、故事板、产品展示图等)

- 包含文字的图片(海报、封面、名片等)

- 复杂场景,需要保持逻辑一致性

- 对细节要求较高,需要精确控制的图片

不需要思考模式的场景:

- 简单的配图(如文章插图)

- 单张图片,关联性要求不高

- 追求生成速度的快速迭代场景

- 只需要AI自由发挥的创意探索

3.3 使用技巧

技巧一:详细描述不如准确描述

很多人在描述需求时喜欢”堆形容词”——”我要一个非常beautiful的、充满vibrant色彩的、看起来very professional的图片”。

对于快速模式,这种描述可能还行。但对于思考模式,我建议换一个思路:准确描述你想要的元素和它们的关系。

比如:

- ❌ “我要一个非常温馨浪漫的咖啡厅场景”

- ✅ “一个阳光明媚的下午,咖啡厅靠窗位置,一位年轻女性正在看书,桌上放着一杯拿铁和一本摊开的书,窗外是街景”

后者给了AI更具体的信息,思考模式也能更好地理解和执行。

技巧二:指定参考风格

如果你有明确的风格参考,可以直接告诉AI:

- “参考宫崎骏动画的风格”

- “模仿葛饰北斋的浮世绘”

- “参考无印良品的产品目录风格”

思考模式会更好地理解这些风格特征,并保持一致性。

技巧三:利用推理详情

点击思考模式的推理详情,你可以看到AI的思考过程。这不仅能帮你理解AI是如何”理解”你的需求的,还能发现一些意想不到的创意点。

四、Images 2.0的局限与不足

4.1 仍然存在的问题

虽然Images 2.0有了明显进步,但仍然有一些问题值得关注:

精细文字仍有挑战:对于复杂的长段文字(比如古诗词),虽然比之前好了很多,但”书法质感”还是差点意思,看起来更像是”印刷品”而非”手写体”。

二维码生成不稳定:在测试中,我尝试生成包含可识别二维码的图片,但多次尝试都失败了。这可能是技术限制,也可能是未来版本会优化的方向。

复杂动作场景:对于需要精确表现动作的瞬间(比如体育赛事、舞蹈动作),Images 2.0的表现还不够完美,有时候会出现”畸形”或”模糊”。

4.2 与竞品的对比

客观来说,Images 2.0在某些方面仍然落后于专门的AI绘图工具:

与Midjourney对比:Midjourney在艺术性、创意性方面仍然领先,尤其是在风格探索和美学表现上。如果你追求的是”好看的艺术图片”,Midjourney可能更合适。

与Stable Diffusion对比:SD的优势在于本地部署和高度可定制性。对于有技术背景的用户来说,SD的控制粒度更高。

Images 2.0的优势:它的核心优势在于与ChatGPT的深度整合——你可以一边对话一边生成图片,AI能理解更复杂的上下文,生成结果也更能”听懂人话”。

五、对行业的意义

5.1 “推理能力”将成为AI图像的核心竞争力

Images 2.0的思考模式,传递出一个重要信号:AI图像生成正在从”生成能力”竞争转向”理解能力”竞争。

过去几年,各大厂商比拼的主要是”生成质量”——谁的图片更清晰、谁的渲染更逼真、谁的风格更多样。但当基础能力都达到一定水平后,竞争的焦点就转向了”理解能力”:谁能更好地理解用户需求,谁就能生成更符合预期的图片。

从这个角度看,Images 2.0的思考模式代表了一个新的方向。

5.2 工具链整合是趋势

Images 2.0另一个值得关注的特点是:它不是一个独立的工具,而是ChatGPT生态的一部分。

这意味着什么?意味着用户可以在同一个界面里完成:对话→提问→生成图片→编辑图片→生成下一张→再编辑……整个工作流被打通了。

对于创作者来说,这种”一站式体验”比在不同工具之间切换要高效得多。预计未来会有更多AI工具走向”生态整合”的方向,而不是继续做”单点突破”。

5.3 创作者应该如何应对

面对越来越强大的AI绘图工具,创作者应该如何自处?

我的看法是:学会利用工具,但不要被工具限制。

AI工具越来越强大,但它们本质上是”执行层面的加速器”。它们可以帮你快速把想法变成图片,但它们无法帮你想到那个”好点子”。

所以,与其花大量时间去探索”怎么用AI画出更炫酷的图片”,不如多花时间思考:

- 我想要表达什么?

- 我的受众想看到什么?

- 什么样的图片能真正打动人心?

当你想清楚了这些问题,AI会成为你最得力的助手。但如果你只是机械地输入prompt然后期待奇迹,那再强大的AI也救不了你。

六、实测案例分享

案例一:科技杂志封面

我上传了一张团队合照,然后输入:”做一本《科技前沿》杂志的封面,封面是图片里这几个人。”

生成结果:

- 保持了原照片的人物特征,没有出现”重绘”问题

- 自动生成了杂志标题、日期、条形码等元素

- 背景换成了科技感的抽象图案

- 整体效果专业且协调

案例二:历史诗词书法

输入:”一幅毛笔书法作品在博物馆展出,上书《沁园春·雪》全文。”

生成结果:

- 中文文字完整、准确,没有乱码

- 书法作品有基本的”毛笔质感”(虽然细看还是像印刷品)

- 博物馆场景的氛围渲染得当

- 光影效果自然

案例三:连续漫画

输入一组8张的摩托车主题漫画,要求封面和封底彩色、其余黑白,画风参考石森章太郎。

生成结果:

- 8张图片画风高度统一

- 摩托车主角的造型在不同场景下保持一致

- 剧情有基本的故事逻辑

- 黑白页面和彩色封面的转换处理得当

结语

回到文章开头的问题:ChatGPT Images 2.0真的不一样吗?

我的答案是:是的,这次确实有实质性的进步。

思考模式的引入,解决了AI图像生成中的一些”老大难”问题——文字崩坏、画风不统一、逻辑不一致。这些问题以前只能靠人工后期修复,现在AI自己就能处理得八九不离十。

当然,它还不是完美的。某些场景下仍然需要人工干预,某些类型的图片生成效果仍然不够理想。但作为一个内置于对话机器人的图像生成功能,Images 2.0的表现已经超出了我的预期。

如果你已经在使用ChatGPT,建议试试新的Images 2.0功能。不管你是内容创作者、设计师,还是只是对AI感兴趣的好奇用户,都可以在这个新工具中找到乐趣。

最后,送给大家一句话:AI不会取代创作者,但会用AI的创作者会取代不会用AI的创作者。

与君共勉。

相关工具教程:

- [Midjourney V8.1使用教程] – 另一个强大的AI绘图工具

- [AI提示词优化指南] – 让AI更好地理解你的绘图需求

- [AI图像生成工具合集] – 更多AI绘图工具推荐

发表回复